トレンドトピック

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

CoTを見た目が良くするように訓練しなければ、CoTを監視することである程度の安全性を得ることができます。

これは良さそうですね!

しかし、これが安全ケースで耐荷重性があるほど確実に機能するかどうかは懐疑的です。

さらに、RLがスケールアップするにつれて、CoTはますます読みにくくなると予想しています。

7月16日 00:00

簡単なAGI安全技術:AIの考えは平易な英語で書かれています、それを読んでください

私たちはそれがうまくいくことを知っています、OK(完璧ではない)透明性で!

リスクは脆弱性です:RLトレーニング、新しいアーキテクチャなどは透明性を脅かします

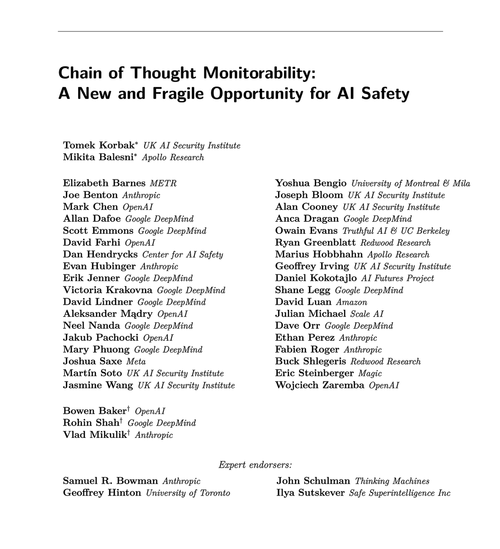

多くの組織の専門家は、それを保存しようとすべきであることに同意しています。 🧵

明確にするために:CoTモニタリングは便利で、モデルのハッキング報酬、偽のアライメントなどのインスタンスを発見できます。

しかし、悪い「思考」がないからといって、モデルが一致しているという証拠にはなりません。prod LLM が誤解を招く CoT を持つ例はたくさんあります。

多くのひどい安全上の失敗はおそらく推論を必要としますが、それはしばしばLLMがCoTでその手を示さずに行うのは難しいです。

たしか。よく。多くの注意点があります。

この論文の著者は次のように述べています。私はこれがどれほど役立つかについて彼らよりも悲観的です。

65.86K

トップ

ランキング

お気に入り