Trendande ämnen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Om du inte tränar dina barnsängar att se snygga ut kan du få lite säkerhet genom att övervaka dem.

Detta verkar bra att göra!

Men jag är skeptisk till att detta kommer att fungera tillräckligt tillförlitligt för att vara bärande i ett säkerhetsfall.

Plus att när RL skalas upp förväntar jag mig att CoTs kommer att bli mindre och mindre läsbara.

16 juli 00:00

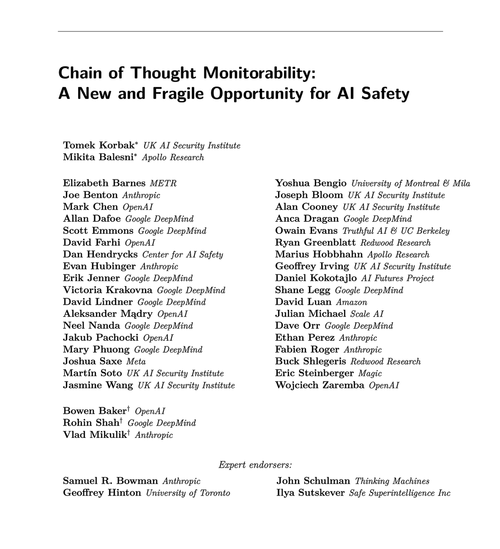

En enkel AGI-säkerhetsteknik: AI:s tankar är på vanlig engelska, det är bara att läsa dem

Vi vet att det fungerar, med OK (inte perfekt) transparens!

Risken är bräcklighet: RL-utbildning, nya arkitekturer etc. hotar transparensen

Experter från många organisationer är överens om att vi bör försöka bevara den: 🧵

För att vara tydlig: CoT-övervakning är användbart och kan låta dig upptäcka fall av modellhackningsbelöningar, fejkad inriktning, etc.

Men frånvaron av dåliga "tankar" är inte ett bevis på att modellen är i linje. Det finns gott om exempel på prod LLM:er som har vilseledande CoT:er.

Många flagranta säkerhetsbrister kräver förmodligen resonemang, vilket ofta är svårt för LLM:er att göra utan att visa sin hand i CoT.

Troligtvis. Ofta. En hel del varningar.

Författarna till denna uppsats säger detta; Jag är bara mer pessimistisk än dem om hur användbart detta kommer att vara.

65,88K

Topp

Rankning

Favoriter