Tendencias del momento

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

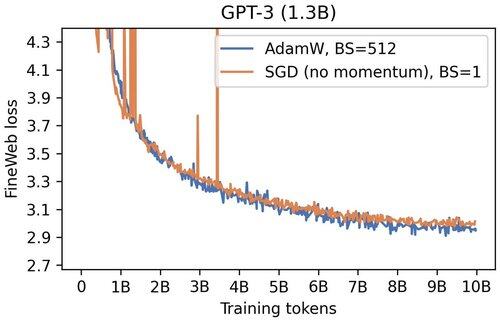

🚨 ¿Sabías que el SGD de vainilla en lotes pequeños sin momentum (es decir, el primer optimizador que aprendes en introducción al ML) es prácticamente tan rápido como AdamW para el preentrenamiento de LLM en base a cada FLOP? 📜 1/n

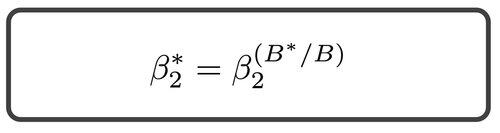

Se piensa que el entrenamiento de LLM en lotes pequeños es lento por FLOP, lo que motiva la acumulación de gradientes para simular lotes más grandes, incluso en ejecuciones académicas a pequeña escala. Mostramos que una regla simple para escalar los hiperparámetros de Adam permite un entrenamiento eficiente por FLOP hasta un tamaño de lote de 1. 4/n

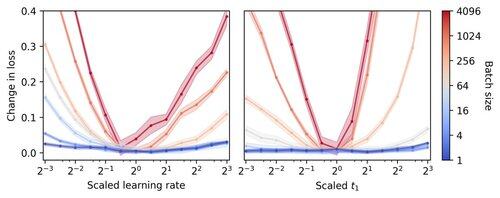

Observamos que el entrenamiento en pequeños lotes es altamente robusto a los hiperparámetros del optimizador, como la tasa de aprendizaje y el momento. Esto significa que, con un presupuesto fijo para la sintonización de hiperparámetros, encontrarás mejores hiperparámetros en el régimen de pequeños lotes. 6/n

341,21K

Parte superior

Clasificación

Favoritos