Trendande ämnen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

RT för att hjälpa Simon att öka medvetenheten om snabba injektionsattacker hos LLM:er.

Känns lite som vilda västern av tidig datoranvändning, med datavirus (nu = skadliga uppmaningar som gömmer sig i webbdata/verktyg), och inte välutvecklade försvar (antivirus, eller ett mycket mer utvecklat säkerhetsparadigm för kärna/användarrymd där t.ex. en agent ges mycket specifika åtgärdstyper istället för möjligheten att köra godtyckliga bash-skript).

Konfliktfylld eftersom jag vill vara en tidig användare av LLM-agenter i min persondator, men vilda västern av möjligheter håller mig tillbaka.

16 juni 2025

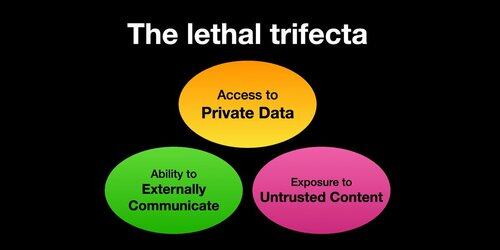

If you use "AI agents" (LLMs that call tools) you need to be aware of the Lethal Trifecta

Any time you combine access to private data with exposure to untrusted content and the ability to externally communicate an attacker can trick the system into stealing your data!

Jag bör klargöra att risken är högst om du kör lokala LLM-agenter (t.ex. Cursor, Claude Code, etc.).

Om du bara pratar med en LLM på en webbplats (t.ex. ChatGPT) är risken mycket lägre *om inte* du börjar aktivera Connectors. Till exempel såg jag precis att ChatGPT lägger till MCP-stöd. Detta kommer att kombineras särskilt dåligt med alla nyligen tillagda minnesfunktioner - föreställ dig t.ex. att ChatGPT berättar allt den vet om dig till någon angripare på internet bara för att du har markerat fel ruta i inställningarna för Connectors.

385,98K

Topp

Rankning

Favoriter