Populaire onderwerpen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

PUMP openbare verkoop is afgelopen, oorspronkelijk had ik ook een groot bedrag op Bybit, op de blockchain had ik maar de helft staan, uiteindelijk is alleen de blockchain-transactie geslaagd, gelukkig had ik niet te vroeg afgedekt...

Trouwens, er wordt de laatste tijd veel gediscussieerd over VLA (Vision‑Language‑Action) in de AI-gemeenschap.

Ik heb speciaal onderzocht of er op de blockchain-projecten zijn die met VLA bezig zijn, en ik zag dit CodecFlow @Codecopenflow project, dus ik heb een beetje gekocht.

== Wat doet het CodecFlow-project? ==

Een korte introductie van VLA: VLA is een modelstructuur die AI in staat stelt niet alleen "te kunnen praten", maar ook "te kunnen handelen".

Traditionele LLM's (zoals GPT) kunnen alleen taal begrijpen en suggesties geven, maar ze kunnen niet zelf handelen, niet op het scherm klikken, en niet objecten vastpakken.

Het VLA-model betekent dat het drie belangrijke capaciteiten integreert:

1. Vision (zicht): begrijpen van beelden, screenshots, camerainvoer of sensorinformatie

2. Language (taal): begrijpen van natuurlijke taalopdrachten van mensen

3. Action (actie): genereren van uitvoerbare instructies, zoals muisklikken, toetsenbordinvoer, en het besturen van een robotarm.

CodecFlow is bezig met VLA op de blockchain, alle operationele processen kunnen ook op de blockchain worden vastgelegd, zijn controleerbaar, verifieerbaar en afrekenbaar.

Kortom, het is de basisinfrastructuur voor een "AI-robot".

== Waarom let ik speciaal op dit project? ==

Ik ontdekte dat hun ontwikkelaars de kernbijdragers zijn van het meest populaire open-sourceproject in het VLA-gebied, LeRobot!

LeRobot is de topbasis voor het bouwen van VLA-modellen in de open-sourcewereld, inclusief SmolVLA, dat op een laptop kan draaien.

Dit betekent dat dit team echt begrijpt hoe VLA-structuren en robots werken.

Ik zie ook dat ze continu aan het bouwen zijn, de prijs van de munt is ook stabiel aan het stijgen, ik ben zelf erg optimistisch over de VLA-sector, en vanuit het algemene perspectief is VLA en robots in de markt zeker de toekomst.

• Web2-giganten (Google, Meta, Tesla) hebben momenteel allemaal volop geïnvesteerd in VLA & robottraining;

• Er zijn heel weinig Web3-projecten die VLA-toepassingen hebben die taken kunnen uitvoeren, wat nog steeds zeer schaars is.

• VLA heeft de kans om enorme waarde te creëren in scenario's zoals DePIN, Web Automation, en blockchain AI-agentuitvoering.

CA: 69LjZUUzxj3Cb3Fxeo1X4QpYEQTboApkhXTysPpbpump

Altijd DYOR.

26 jun 2025

Wat is een $CODEC Operator?

Het is waar Vision-Language-Action modellen AI eindelijk nuttig maken voor echt werk.

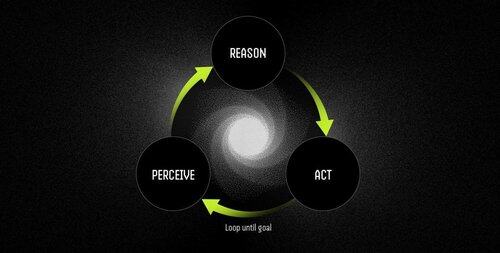

Een Operator is een autonome software-agent aangedreven door VLA-modellen die taken uitvoert via een continue waarnemen-redeneren-actie cyclus.

LLM's kunnen briljant denken en praten, maar ze kunnen niets aanwijzen, klikken of vastpakken. Ze zijn pure redeneermachines zonder enige verankering in de fysieke wereld.

VLA's combineren visuele waarneming, taalbegrip en gestructureerde actie-output in één enkele doorlopende stap. Terwijl een LLM beschrijft wat er zou moeten gebeuren, maakt een VLA-model het daadwerkelijk mogelijk door coördinaten, controlesignalen en uitvoerbare commando's uit te zenden.

De workflow van de Operator is:

- Waarneming: legt screenshots, camerafeeds of sensorgegevens vast.

- Redeneren: verwerkt observaties naast natuurlijke taal instructies met behulp van het VLA-model.

- Actie: voert beslissingen uit via UI-interacties of hardwarecontrole - allemaal in één continue lus.

Voorbeelden: LLM vs. Operator Aangedreven door VLA Model

Een Vergadering Inplannen

LLM: Biedt een gedetailleerde uitleg over kalenderbeheer, met stappen om een vergadering in te plannen.

Operator met VLA Model:

- Legt het bureaublad van de gebruiker vast.

- Identificeert de kalenderapplicatie (bijv. Outlook, Google Agenda).

- Navigeert naar donderdag, maakt een vergadering om 14:00 uur aan en voegt deelnemers toe.

- Past zich automatisch aan veranderingen in de gebruikersinterface aan.

Robotica: Objecten Sorteren

LLM: Genereert nauwkeurige geschreven instructies voor het sorteren van objecten, zoals het identificeren en organiseren van rode componenten.

Operator met VLA Model:

- Observeert de werkruimte in real-time.

- Identificeert rode componenten tussen gemengde objecten.

- Plant botsingsvrije trajecten voor een robotarm.

- Voert pick-and-place operaties uit, zich dynamisch aanpassend aan nieuwe posities en oriëntaties.

VLA-modellen overbruggen eindelijk de kloof tussen AI die kan redeneren over de wereld en AI die deze daadwerkelijk kan veranderen. Ze transformeren automatisering van fragiele regelvolging naar adaptief probleemoplossend vermogen - intelligente werknemers.

"Traditionele scripts breken wanneer de omgeving verandert, maar Operators gebruiken visueel begrip om zich in real-time aan te passen, waarbij ze uitzonderingen afhandelen in plaats van erop te crashen."

10,71K

Boven

Positie

Favorieten