Temas en tendencia

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

La venta pública de PUMP ha terminado, originalmente también era una gran cantidad en Bybit, solo 1/2 en la cadena, y al final, solo la cadena tuvo éxito, afortunadamente no hubo cobertura por adelantado ...

Recientemente, ha habido mucha discusión en la comunidad de IA sobre VLA (Visión-Lenguaje-Acción)

En particular, fui a investigar si había alguien haciendo proyectos relacionados con VLA en la cadena, y vi este proyecto CodecFlow@Codecopenflow y compré un poco.

== ¿Qué está haciendo CodecFlow? ==

Una breve introducción a VLA, una arquitectura de modelo que permite a la IA no solo "hablar", sino "hacer".

Los LLM tradicionales (como GPT) solo pueden entender el lenguaje y dar sugerencias, pero no pueden hacer manualidades, hacer clic en pantallas o agarrar objetos.

El modelo VLA significa que integra tres capacidades:

1. Visión: Comprenda imágenes, capturas de pantalla, entradas de cámara o datos de sensores

2. Lenguaje: Comprender las instrucciones del lenguaje natural humano

3. Acción: Genere comandos ejecutables, como clics del mouse, entrada de teclado y control del brazo robótico

CodecFlow realiza el VLA en la cadena, y todos los procesos también se pueden cargar en la cadena, que se pueden auditar, verificar y liquidar.

En términos simples, es la infraestructura de un "bot de IA".

== ¿Por qué estoy prestando especial atención a este artículo? ==

Descubrí que sus desarrolladores son los principales contribuyentes de LeRobot, el proyecto de código abierto más popular en el espacio VLA.

LeRobot es la base principal para la creación de modelos VLA en el mundo del código abierto, incluidos los VLA ligeros que pueden ejecutarse en portátiles como SmolVLA.

Significa que este equipo realmente entiende la arquitectura VlA y el robot.

Veo que también continúan construyendo, y el precio de la moneda también está subiendo constantemente, soy muy optimista sobre la pista de VLA y, según la tendencia general, VLA y los robots son de hecho el futuro en el mercado.

• Los gigantes de la Web2 (Google, Meta, Tesla) están ahora totalmente comprometidos con la formación de VLA y bots;

• Los proyectos Web3 son escasos en cuanto a aplicaciones VLA que puedan realizar tareas

• VLA tiene la oportunidad de desempeñar un papel muy importante en escenarios como DePIN, automatización web y ejecución de agentes de IA en cadena.

CA:69LjZUUzxj3Cb3Fxeo1X4QpYEQTboApkhXTysPpbpump

Siempre DYOR。

26 jun 2025

¿Qué es un operador $CODEC?

Es donde los modelos de Visión-Lenguaje-Acción finalmente hacen que la IA sea útil para el trabajo real.

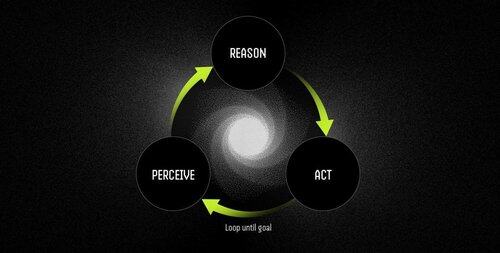

Un operador es un agente de software autónomo impulsado por modelos VLA que realiza tareas a través de un ciclo continuo de percepción-razón-acción.

Los LLM pueden pensar y hablar de manera brillante, pero no pueden señalar, hacer clic o agarrar nada. Son motores de razonamiento puro sin conexión a tierra en el mundo físico.

Las VLA combinan la percepción visual, la comprensión del lenguaje y la salida de acción estructurada en un solo paso hacia adelante. Mientras que un LLM describe lo que debería suceder, un modelo VLA en realidad lo hace mediante la emisión de coordenadas, señales de control y comandos ejecutables.

El flujo de trabajo del operador es:

- Percepción: captura capturas de pantalla, imágenes de cámaras o datos de sensores.

- Razonamiento: procesa las observaciones junto con las instrucciones del lenguaje natural utilizando el modelo VLA.

- Acción: ejecuta decisiones a través de interacciones de la interfaz de usuario o control de hardware, todo en un bucle continuo.

Ejemplos: LLM vs. Operador impulsado por el modelo VLA

Programación de una reunión

LLM: Proporciona una explicación detallada de la administración del calendario, describiendo los pasos para programar una reunión.

Operador con modelo VLA:

- Captura el escritorio del usuario.

- Identifica la aplicación de calendario (por ejemplo, Outlook, Google Calendar).

- Navega hasta el jueves, crea una reunión a las 2 p.m. y agrega asistentes.

- Se adapta automáticamente a los cambios en la interfaz de usuario.

Robótica: Clasificación de objetos

LLM: Genera instrucciones escritas precisas para clasificar objetos, como identificar y organizar componentes rojos.

Operador con modelo VLA:

- Observa el espacio de trabajo en tiempo real.

- Identifica los componentes rojos entre los objetos mezclados.

- Planifica trayectorias sin colisiones para un brazo robótico.

- Ejecuta operaciones de selección y colocación, ajustándose dinámicamente a nuevas posiciones y orientaciones.

Los modelos VLA finalmente cierran la brecha entre la IA que puede razonar sobre el mundo y la IA que realmente puede cambiarlo. Son los que transforman la automatización de un frágil seguimiento de reglas en una resolución de problemas adaptativa: trabajadores inteligentes.

"Los scripts tradicionales se rompen cuando cambia el entorno, pero los operadores utilizan la comprensión visual para adaptarse en tiempo real, manejando las excepciones en lugar de bloquearse en ellas".

10.69K

Populares

Ranking

Favoritas