热门话题

#

Bonk 生态迷因币展现强韧势头

#

有消息称 Pump.fun 计划 40 亿估值发币,引发市场猜测

#

Solana 新代币发射平台 Boop.Fun 风头正劲

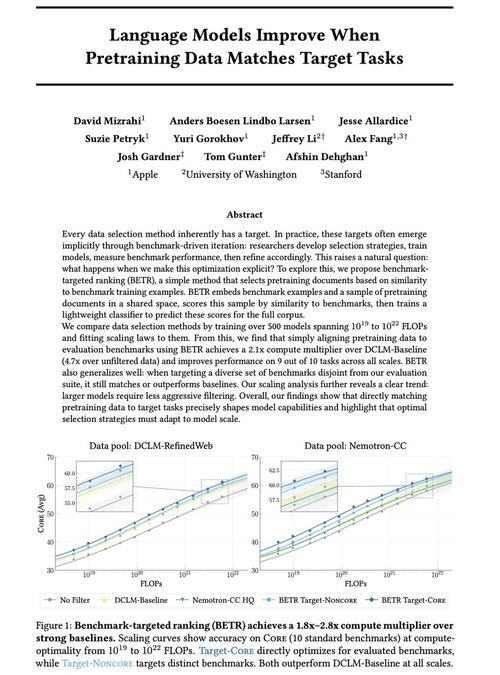

很高兴分享我们的新工作:“当预训练数据与目标任务匹配时,语言模型会得到改善”

是的,这听起来很明显(确实如此!),但通常这只是隐性和间接发生的:直观选择数据 → 基准测试 → 精炼 → 重复。

我们想知道:如果我们明确将预训练数据与基准匹配,会发生什么?结果是一个简单的方法,能够在强基线之上实现2倍以上的计算倍增,并为我们提供了一种原则性的方法来研究基准选择如何塑造(和限制!)模型能力。

额外内容:从训练500多个模型中获得的广泛扩展法则,揭示了随着模型扩展,最佳数据选择如何演变。

🧵 (1/14)

51.99K

热门

排行

收藏