Актуальні теми

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Misha Laskin

Співзасновник, генеральний директор @reflection_ai.

Попередня: Науковий співробітник @DeepMind.

Команда Gemini RL.

Користувач Misha Laskin поділився

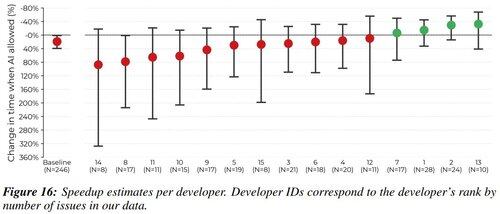

Я був одним із 16 розробників у цьому дослідженні. Я хотів висловити свою думку про причини та стратегії пом'якшення наслідків уповільнення роботи розробників.

Я скажу як гачок «навіщо вас слухати?», що я відчув прискорення штучного інтелекту на -38% у призначених мені питаннях. Я думаю, що прозорість допомагає громаді.

1,96M

Найбільшим питанням у дослідженнях RL завжди було – в якому середовищі ви тренуєтеся?

Раніше це були відео (Atari) і настільні (Go / Chess) ігри.

Але тепер, коли RL працює з LLM, є лише одне середовище, яке має значення. І це ваш продукт.

Kevin Lu10 лип., 00:01

Чому варто перестати працювати над дослідженнями RL і замість цього працювати над продуктом //

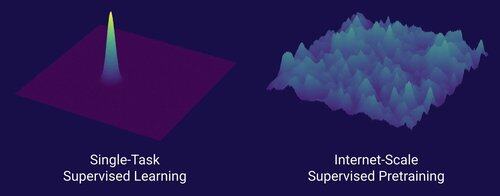

Технологія, яка відкрила великий зсув у масштабуванні штучного інтелекту, – це інтернет, а не трансформери

Я думаю, добре відомо, що дані є найважливішою річчю в штучному інтелекті, а також що дослідники все одно вирішують не працювати над ними. ... Що означає працювати з даними (масштабованим способом)?

Інтернет надавав багате джерело багатих даних, які були різноманітними, надавали природну навчальну програму, представляли компетенції, про які люди насправді дбають, і були економічно вигідною технологією для масштабного розгортання – він став ідеальним доповненням до прогнозування наступних токенів і був первісним бульйоном для зльоту штучного інтелекту.

Без трансформаторів могла б злетіти будь-яка кількість підходів, ми, напевно, могли б мати CNN або державні космічні моделі на рівні GPT-4.5. Але кардинального покращення базових моделей не відбулося з часів GPT-4. Моделі міркувань чудові у вузьких сферах, але не такий великий стрибок, як GPT-4 був у березні 2023 року (понад 2 роки тому...)

У нас є щось чудове з навчанням з підкріпленням, але мій глибокий страх полягає в тому, що ми повторимо помилки минулого (епоха 2015-2020 років RL) і проведемо дослідження RL, які не мають значення.

Подібно до того, як Інтернет був дуалом контрольованої попередньої підготовки, що буде дуалом RL, що призведе до масового прогресу, як GPT-1 -> GPT-4? Я думаю, що це виглядає як спільне проектування досліджень і продукту.

10,67K

Користувач Misha Laskin поділився

Невеликі моделі з RL легко налаштувати так, щоб вони перевершували базові моделі у вертикальних завданнях.

Ми відкриті для використання Osmosis-Apply-1.7B: невелика модель, яка об'єднує код (подібно до миттєвого застосування Cursor) краще, ніж моделі foundation.

Посилання на скачування та випробування моделі нижче!

111,37K

Найкращі

Рейтинг

Вибране

Актуальне ончейн

Популярні в X

Нещодавнє найкраще фінансування

Найбільш варте уваги