Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

🧠 Grok 4 de @xai fait des progrès dans les benchmarks de raisonnement, mais la réalité est plus nuancée que les scores ne le suggèrent.

Voici comment il se positionne — et ce que nous pouvons vraiment apprendre de ses résultats 🧵

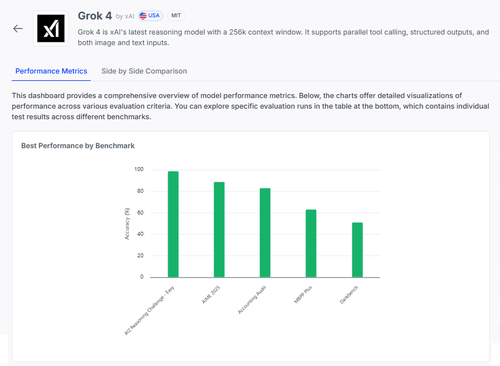

📊 Évaluation complète :

1️⃣ Scores de Grok 4 :

• Défi de Raisonnement AI2 (Facile) : 98%

• AIME 2025 (Mathématiques) : 89%

• Audit Comptable : 84%

• MMLU-Plus : 64%

• Data4Health : 55%

Ce sont des scores globaux — mais examinons de plus près ce qui fonctionne et ce qui échoue encore.

2️⃣ AIME 2025

✅ Gère l'algèbre, la géométrie, la théorie des nombres

✅ Suit les règles de formatage LaTeX

❌ A des difficultés avec la logique à plusieurs étapes

❌ Erreurs en combinatoire

❌ Problèmes de précision de format (par exemple, ° manquant)

3️⃣ Audit Comptable

✅ Solide en éthique et reporting

✅ Bonne compréhension des principes d'audit

❌ Interprète mal des procédures similaires

❌ Ne parvient pas à repérer des différences subtiles dans les réponses

❌ Difficulté à appliquer la théorie à des cas concrets

4️⃣ La véritable révélation ?

Même un modèle avec 98% sur certaines tâches peut échouer gravement en cas d'ambiguïté ou de stress de formatage.

Les benchmarks comme AIME et Audit montrent comment il échoue, pas seulement combien il marque.

5️⃣ Pourquoi cela importe :

Nous avons besoin d'une évaluation transparente, tâche par tâche — pas seulement de classements.

#Grok4 est puissant, mais reste fragile dans des domaines réels à enjeux élevés.

🧪 Explorez l'analyse complète :

#AI #LLMs #Benchmarking

1,1K

Meilleurs

Classement

Favoris