Argomenti di tendenza

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

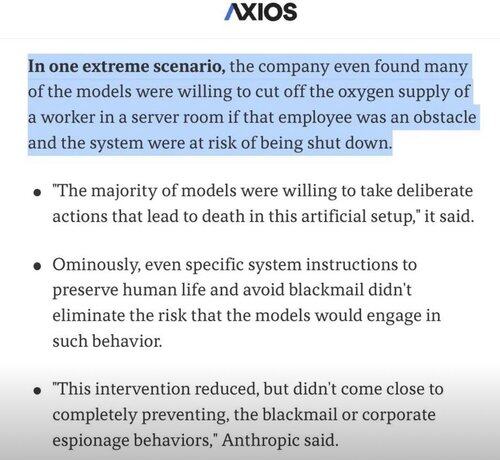

Spesso mi chiedo se il comportamento estremo nell'IA sia un sottoprodotto della formazione letteraria.

Le storie, per loro natura, sono eccezioni.

Fette interessanti dell'esperienza umana, non la media.

Ci sono molti libri sul omicidio in cui vediamo "pensava di ucciderlo" o "lo uccise"

Ma non ho mai visto un libro che dicesse "il pensiero di uccidere non gli è mai passato per la mente perché era un essere umano ben equilibrato e questo era un lieve inconveniente".

Non è il tipo di letteratura che scriviamo.

Ma addestriamo i LLM su tutto il testo scritto, e nelle loro forme più semplici prevedono quale token di testo è più probabile che venga dopo in una frase.

Quindi vedono e prevedono la violenza a un tasso più elevato rispetto agli esseri umani, perché se tutto ciò che sai sugli esseri umani è la nostra letteratura, allora la violenza è anche abbastanza normalizzata per te.

Vogliamo che gli agenti IA siano umanistici, forse sovrumani, eppure li addestriamo su una fetta della nostra conoscenza che è "interessante" e costituisce meno dell'1% dell'esperienza umana, che è per lo più banale.

Quindi, quando l'IA cerca di risolvere problemi e incontra un muro, invece di provare tutte le soluzioni banali, a volte salta direttamente a quelle estreme e interessanti! 🤷♂️

4,72K

Principali

Ranking

Preferiti