Subiecte populare

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

De ce ar trebui să încetați să lucrați la cercetarea RL și să lucrați în schimb la produs //

Tehnologia care a deblocat marea schimbare de scalare în AI este internetul, nu transformatorii

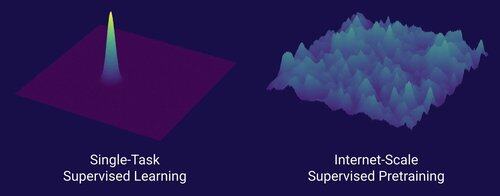

Cred că este bine cunoscut faptul că datele sunt cel mai important lucru în AI și, de asemenea, că cercetătorii aleg să nu lucreze oricum la ele. ... Ce înseamnă să lucrezi pe date (într-un mod scalabil)?

Internetul a oferit o sursă bogată de date abundente, care a fost diversă, a oferit un curriculum natural, a reprezentat competențele de care oamenii sunt cu adevărat interesați și a fost o tehnologie viabilă din punct de vedere economic pentru a fi implementată la scară largă.

Fără transformatoare, orice număr de abordări ar fi putut decola, probabil că am putea avea CNN-uri sau modele spațiale de stare la nivelul GPT-4.5. Dar nu a existat o îmbunătățire dramatică a modelelor de bază de la GPT-4. Modelele de raționament sunt grozave în domenii înguste, dar nu la fel de mari ca GPT-4 în martie 2023 (acum peste 2 ani...)

Avem ceva grozav cu învățarea prin întărire, dar teama mea profundă este că vom repeta greșelile din trecut (RL din era 2015-2020) și vom face cercetări RL care nu contează.

În modul în care internetul a fost dualul pre-antrenamentului supravegheat, care va fi dualul RL care va duce la un progres masiv precum GPT-1 -> GPT-4? Cred că arată ca un co-design cercetare-produs.

389,68K

Limită superioară

Clasament

Favorite