Trendande ämnen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Mitt första @delphi_intel inlägg handlar om Gen AI Video Models. Sammanfattning nedan (1/10) 👇

S/O till @moonshot6666 för hans feedback på denna uppsats och @PJaccetturo för denna dope hype video jag kommer skamlöst att stjäla.

TLDR: videor ligger 2-3 år efter text. De blir väldigt bra, väldigt snabbt

1. Människor är visuella varelser.

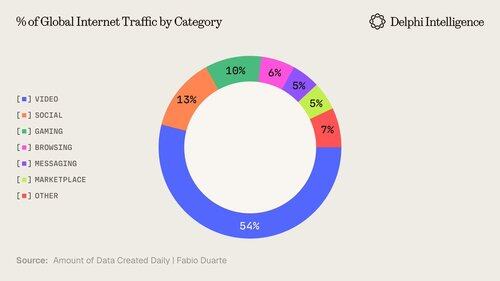

Gen AI-innehållsmodalitet kommer sannolikt att trenda mot en distribution som liknar webben:

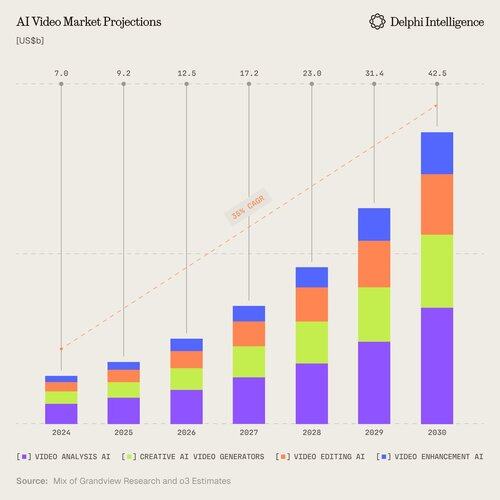

2. Marknaden är stor: >40 miljarder USD+ miljarder år 2030 (med relevanta angränsningar).

Störningarna inom marknadsföring, underhållning och utbildning är uppenbara, men också tydliga konsekvenser för robotik, övervakning och agentiska uppgifter med lång horisont

3. Landskapet har mycket konkurrens mellan staplar

Inkluderar modellföretag, multimodala appar, talande avatarer, läppsynk och mer. För att inte tala om all den infrastruktur som krävs för att driva verkliga multimodala modeller och appar.

S/O till @venturetwins och @a16z för kartan

4. Öst mot väst.

Kapplöpningen är till stor del uppdelad mellan USA och Kina. När det gäller videomodeller är Kina ledande (9 av de 15 bästa modellerna)

S/O-@ArtificialAnlys

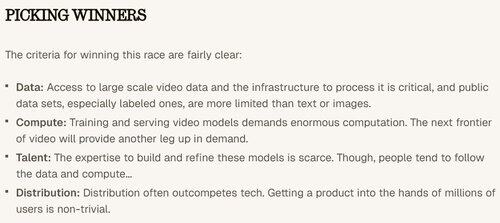

6. Big Tech Advantage: Att överföra dessa nya funktioner till >1b-användarekosystem kommer att ge hög ROI

Baserat på nedanstående attribut är det inte chockerande att stora spelare som $Goog, $meta, $techy, $baba och Bytedance är väl positionerade.

7. Värdeuppbyggnad:

Samtidigt ser vi fickor över hela stacken - särskilt inom infrastruktur och appar - där nya aktörer kan knoppa av stora företag

(Ja, du måste läsa den faktiska rapporten för alla alfa, lata arsle)

8. Verklig multimodalitet

Idag ser videomodeller ut som en leksak. Men videodata och simuleringar blir allt viktigare för agentuppgifter i lång form och för att få fart på robotrevolutionen.

Videomodeller kan vara den tändande gnistan.

3,27K

Topp

Rankning

Favoriter