Popularne tematy

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Mój inauguracyjny post @delphi_intel dotyczy modeli wideo Gen AI. Podsumowanie poniżej (1/10)👇

s/o dla @moonshot6666 za jego uwagi do tego eseju oraz @PJaccetturo za ten świetny film promocyjny, który bezwstydnie ukradnę.

TLDR: filmy są 2-3 lata za tekstem. Stają się bardzo dobre, bardzo szybko.

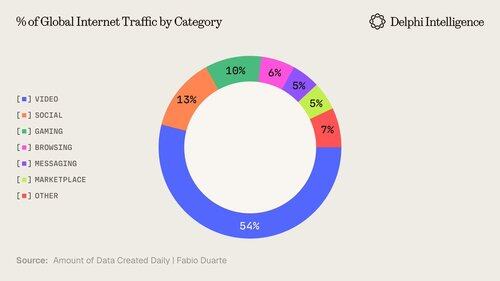

1. Ludzie są istotami wizualnymi.

Modality treści Gen AI prawdopodobnie będzie zmierzać w kierunku rozkładu podobnego do sieci:

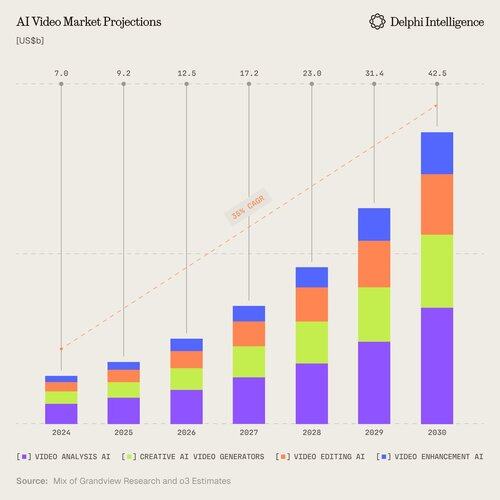

2. Rynek jest duży: >40 miliardów USD do 2030 roku (z odpowiednimi powiązaniami).

Zakłócenia w marketingu, rozrywce i edukacji są oczywiste, ale również jasne implikacje w robotyce, nadzorze i długoterminowych zadaniach agentowych.

3. Krajobraz ma wiele konkurencji międzystackowej

Zawiera firmy modelowe, aplikacje multimodalne, mówiące awatary, synchronizację ruchu warg i wiele więcej. Nie wspominając o całej infrastrukturze potrzebnej do zasilania prawdziwych modeli i aplikacji multimodalnych.

s/o dla @venturetwins i @a16z za mapę

4. Wschód vs. Zachód.

Wyścig jest w dużej mierze podzielony między USA a Chinami. W modelach wideo Chiny prowadzą (9 z 15 najlepszych modeli)

s/o @ArtificialAnlys

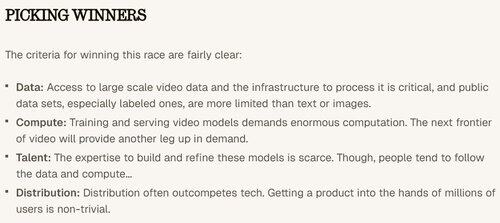

6. Przewaga dużych technologii: dostarczanie tych nowych możliwości do ekosystemów z ponad 1 miliardem użytkowników przyniesie wysoką stopę zwrotu.

Na podstawie poniższych atrybutów, nie jest zaskoczeniem, że duże firmy takie jak $Goog, $meta, $techy, $baba i Bytedance są dobrze przygotowane.

7. Akumulacja wartości:

Jednocześnie dostrzegamy obszary w całym stosie - szczególnie w infrastrukturze i aplikacjach - gdzie nowi gracze mogą wyodrębnić duże biznesy.

(Tak, będziesz musiał przeczytać rzeczywisty raport, aby uzyskać jakiekolwiek informacje, leniuchu)

8. Prawdziwa wielomodalność

Dziś modele wideo wyglądają jak zabawki. Ale dane wideo i symulacje stają się coraz bardziej istotnym wkładem w długoterminowe zadania agentowe i w rozpoczęcie rewolucji robotycznej.

Modele wideo mogą okazać się iskrą.

3,26K

Najlepsze

Ranking

Ulubione