Populaire onderwerpen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Max Ryabinin

Grootschalige deep learning & onderzoek @togethercompute

Learning@home/Hivemind-auteur (DMoE, DeDLOC, SWARM, Bloemblaadjes)

PhD in gedecentraliseerde DL '2023

Als je op ICML bent en geïnteresseerd bent in verifieerbare inferentie, zorg er dan voor dat je bij onze poster langs komt!

We zullen TOPLOC presenteren, een efficiënte activatie-hashingmethode die werkt in verschillende instellingen, bijvoorbeeld bij het wisselen van inferentiesystemen of zelfs modellen.

16 juli, 16:30, E-1106

1,42K

Uit mijn ervaring kan het behoorlijk moeilijk zijn om een paper over gedecentraliseerde DL geaccepteerd te krijgen op topconferenties. De motivatie is voor veel beoordelaars niet bekend, en standaard experimentele instellingen houden geen rekening met de problemen die je probeert op te lossen.

Daarom ben ik erg enthousiast om te zien dat bedrijven zoals @PluralisHQ en @PrimeIntellect de moeite nemen om hun resultaten te delen en deze gepubliceerd te krijgen op grote conferenties! IMO dwingt zelfs het voorbereiden van de indiening je om strenger te zijn over je experimenten + feedback van beoordelaars helpt je om de boodschap van het paper te verfijnen.

Alexander Long14 jul, 08:24

Voor mensen die niet bekend zijn met AI-publicaties; er zijn elk jaar 3 belangrijke conferenties. ICML, ICLR en NeurIPS. Dit zijn technische conferenties en het equivalent van tijdschriften in andere disciplines - ze zijn de belangrijkste publicatieplek voor AI. De concurrentie om papers op deze conferenties te krijgen is nu op een belachelijk niveau, het is erg moeilijk om papers geaccepteerd te krijgen, en er is veel bezorgdheid over het beoordelingsproces dat op dit moment behoorlijk rumoerig is. Een sterk paper zonder gebreken heeft ongeveer 50% kans om geaccepteerd te worden, en typisch wordt een paper meerdere keren ingediend met wijzigingen van reviewers totdat het wordt geaccepteerd. Ondanks dat blijven papers in deze venues de primaire stempel van legitimiteit in de AI-wereld, en zijn ze waarschijnlijk nog steeds de primaire carrière-metrics voor ML-onderzoekers (hoewel dit naar mijn mening verzwakt, aangezien zoveel van het onderzoek in de grenslaboratoria ongepubliceerd is).

Main Track-papers zijn aanzienlijk anders dan workshop-papers. De main track heeft intense, serieuze peer review. Workshop-papers zijn voor voorlopig werk, dat enige indicatie geeft van een interessant resultaat, maar zijn ofwel niet compleet of het resultaat is niet significant genoeg voor de main track. Ze hoeven alleen beoordeeld te worden door de workshop-reviewerpool en ze verschijnen niet in de proceedings.

Veel geweldige papers zijn voor het eerst verschenen in workshops (bijv. grokking) - maar workshop- en main track-papers zijn fundamenteel verschillende dingen, met een fundamenteel verschillend niveau van impact. De enige twee bedrijven in gedecentraliseerde AI die dit jaar main track-papers hebben zijn @PrimeIntellect en Pluralis.

7,27K

Max Ryabinin heeft opnieuw gepost

@gowthami_s @JangLawrenceK @IAmTimNguyen @ishapuri101 gedistribueerde training in machine learning🌍

Doe mee op 12 juli terwijl @Ar_Douillard belangrijke methoden verkent, zoals FSDP, Pipeline & Expert Parallelism, plus opkomende benaderingen zoals DiLoCo en SWARM, die de grenzen van wereldwijde, gedistribueerde training verleggen.

Meer informatie:

7,27K

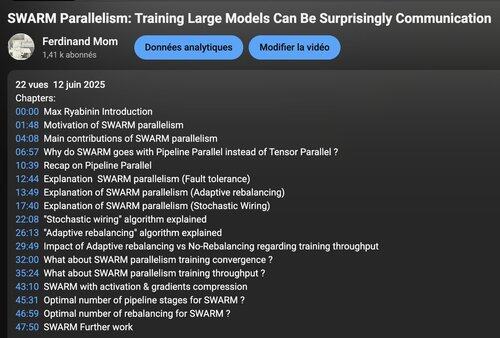

Heel erg bedankt aan Ferdinand voor het hosten van dit gesprek! Het was een geweldige kans om alle onderdelen van SWARM te bekijken en de motivatie erachter in detail te bespreken.

Ik hoop dat deze video gedecentraliseerde DL toegankelijker zal maken: veel ideeën op dit gebied zijn eenvoudiger dan ze lijken!

Ferdinand Mom12 jun 2025

De videoreview van het onderzoeksartikel over "Swarm Parallelism" samen met de auteur @m_ryabinin, Distinguished Research Scientist @togethercompute is nu beschikbaar! Link hieronder 👇

Voor context: de meeste gedecentraliseerde training vandaag de dag volgt DDP-stijl benaderingen die volledige modelreplicatie op elke node vereisen. Hoewel dit praktisch is voor degenen met H100-clusters tot hun beschikking, blijft dit buiten bereik voor de overgrote meerderheid van de potentiële bijdragers, hier komt SWARM van pas!

3,11K

Boven

Positie

Favorieten

Populair op onchain

Populair op X

Recente topfinanciering

Belangrijkste