Populaire onderwerpen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Mistral AI

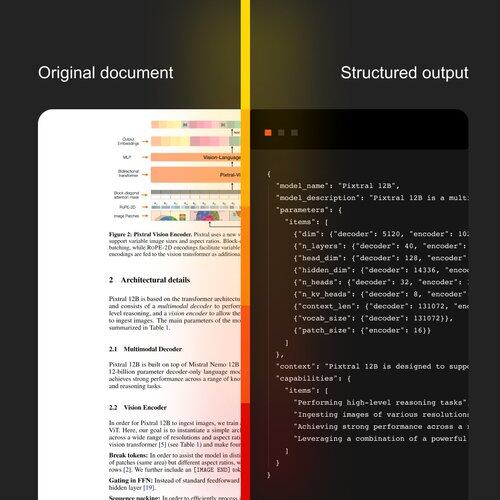

In onze voortdurende toewijding aan open wetenschap, publiceren we het Voxtral Technisch Rapport:

Het rapport behandelt details over pre-training, post-training, afstemming en evaluaties. We presenteren ook een analyse over het selecteren van de optimale modelarchitectuur, welke pre-training indeling te gebruiken, en de voordelen van DPO.

26,5K

Mistral AI heeft opnieuw gepost

Unmute verandert een tekst-LLM in een spraak-AI. Bij @MistralAI is het Mistral-Small-3.2-24B, volledig open-source. Speel een quizspel met een sarcastische host, blijf op de hoogte van het tech-nieuws, of hang gewoon rond en praat. Of pas het aan om te doen wat je maar wilt!

13,36K

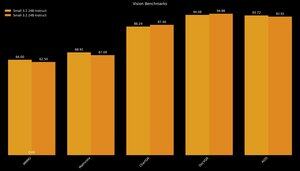

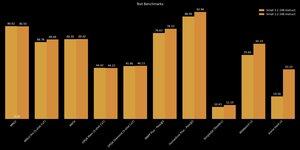

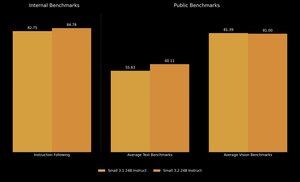

Introductie van Mistral Small 3.2, een kleine update van Mistral Small 3.1 om te verbeteren:

- Instructie opvolging: Small 3.2 is beter in het opvolgen van precieze instructies

- Herhalingsfouten: Small 3.2 produceert minder oneindige generaties of repetitieve antwoorden

- Functieaanroep: De functieaanroep sjabloon van Small 3.2 is robuuster

12,91K

Mistral AI heeft opnieuw gepost

Vandaag brengen we ether0 uit, ons eerste wetenschappelijke redeneermodel.

We hebben Mistral 24B met RL getraind in verschillende moleculaire ontwerptaken in de chemie. Opmerkelijk genoeg ontdekten we dat LLM's sommige wetenschappelijke taken veel data-efficiënter kunnen leren dan gespecialiseerde modellen die helemaal opnieuw zijn getraind op dezelfde gegevens, en veel beter kunnen presteren dan grensmodellen en mensen op die taken. Voor ten minste een subset van wetenschappelijke classificatie-, regressie- en generatieproblemen kunnen LLM's na de training een veel gegevensefficiëntere aanpak bieden dan traditionele machine learning-benaderingen. 1/n

90,27K

Boven

Positie

Favorieten

Populair op onchain

Populair op X

Recente topfinanciering

Belangrijkste