Temas en tendencia

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

¿Alguien ha intentado RL para reescribir indicaciones para modelos de razonamiento para mejorar aún más los resultados?

Supongo que sí, se siente bastante obvio, pero si no, quiero probarlo.

Si conoces algún trabajo existente aquí, por favor lmk para que no vuelva a hacer algo que la gente ya ha hecho.

Con esto, quiero decir:

- Tome un modelo de razonamiento congelado ya entrenado (es decir, o4-mini a través de API)

- Agregue un LLM más pequeño que tome un mensaje y lo reescriba para mejorar el rendimiento del modelo congelado

- Actualice los pesos de los LLM más pequeños, mantenga congelados los LLM más grandes

La esperanza es que el pequeño LLM aprenda a "dirigir" el CoT del modelo más grande congelado mejor de lo que podría hacerlo un humano, aumentando el rendimiento.

@corbtt me recordó este trabajo de @brendanh0gan...

Brendan, ¿cómo te fue? Parece bastante similar a lo que estoy pensando aquí.

3 jul, 08:26

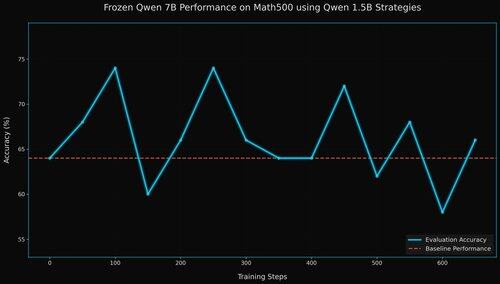

big models are great agents but often too big, closed, or delicate to fine-tune

idea: train a small model to craft context for a frozen big model, score the big model's outputs, use that as reward for the small one

grpo for context tuning. more below

17.5K

Populares

Ranking

Favoritas