Актуальні теми

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Хто-небудь пробував RL переписувати підказки для моделей міркувань для подальшого поліпшення результатів?

Я припускаю, що так, це здається досить очевидним, але якщо ні, я хочу спробувати.

Якщо ви знаєте про будь-яку існуючу роботу тут, будь ласка, lmk, щоб я не переробляв те, що люди вже зробили!

Під цим я маю на увазі:

- Візьміть вже навчену, заморожену модель міркування (наприклад, o4-mini через API)

- Додайте менший LLM, який приймає запит і переписує його, щоб покращити роботу замороженої моделі

- Оновіть меншу вагу LLM, тримайте більший LLM замороженим

Є надія, що маленький LLM навчиться «керувати» CoT замороженої більшої моделі краще, ніж людина, підвищуючи продуктивність.

@corbtt нагадав мені цю роботу @brendanh0gan...

Брендан, як це було? Здається, це дуже схоже на те, про що я тут думаю.

3 лип., 08:26

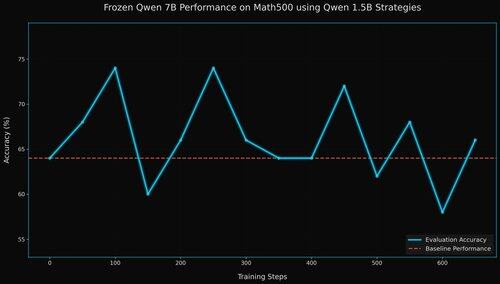

big models are great agents but often too big, closed, or delicate to fine-tune

idea: train a small model to craft context for a frozen big model, score the big model's outputs, use that as reward for the small one

grpo for context tuning. more below

17,49K

Найкращі

Рейтинг

Вибране