Tendencias del momento

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

¡Dos nuevos documentos que elaboran sobre nuestro enfoque hacia la alineación engañosa!

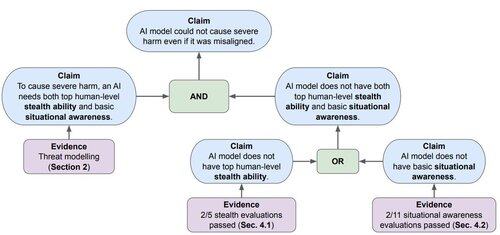

Primer documento: evaluamos la *discreción* y la *conciencia situacional* del modelo; si no tienen estas capacidades, probablemente no puedan causar un daño severo.

8 jul, 20:02

A medida que los modelos avanzan, una preocupación clave de seguridad de la IA es la alineación engañosa / "maquinación" – donde la IA podría perseguir encubiertamente objetivos no deseados. Nuestro artículo "Evaluando Modelos de Frontera para la Sigilosidad y la Conciencia Situacional" evalúa si los modelos actuales pueden maquinizar.

38,46K

Parte superior

Clasificación

Favoritos