Trend-Themen

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Louround 🥂

Mitbegründer von @a1research__ 🀄️ & @steak_studio 🥩

Louround 🥂 erneut gepostet

Aus Stille und Schatten erwacht ein System.

Aus der Isolation trainiert. Entwickelt, um zu erkennen, zu denken und zu handeln.

Die große Enthüllung steht kurz bevor.

Doch bevor die Tore sich öffnen,

dürfen die Erhabenen früh eintreten.

Der frühe Zugang zu CodecFlow ist jetzt live:

11,71K

Gerade herausgefunden, dass ich 9 Einladungscodes für das Testnetz von @anoma verfügbar habe 👀

Kommentiere und retweete diesen Beitrag, ich werde in 24 Stunden 9 Personen auswählen

🥂

Louround 🥂16. Juli, 16:00

Hut ab vor dem Testnetz von @anoma!

Es bietet ein super flüssiges und unterhaltsames Erlebnis mit Nebenquests und täglichen Aufgaben.

Eine neue UI- und UX-Welt entsteht, und sie ist absichtsbasiert ⏳

26,69K

Louround 🥂 erneut gepostet

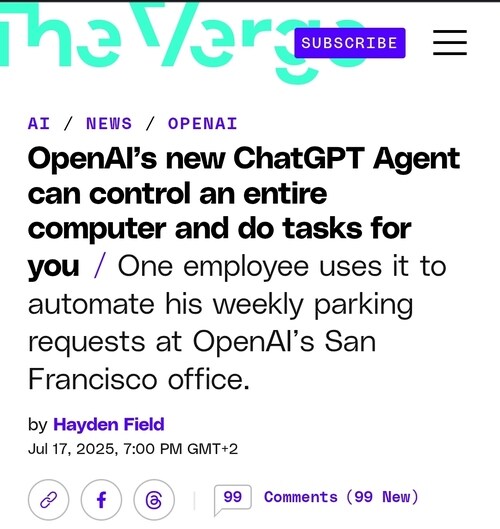

OpenAI hat gerade angekündigt, dass sein Operator-Agent jetzt einen gesamten Computer steuern kann, um eine komplexe Reihe von Aufgaben mithilfe von VLA-Modellen in Kombination mit LLM-Modellen auszuführen.

Vision

Sprache

Aktion

Wenn es nur ein Krypto-Projekt gäbe, das dies bereits tun könnte...

Studieren Sie @codecopenflow

Neben der Steuerung von Desktops kann Codec auch Roboter- und Gaming-Operatoren steuern.

Starten Sie eine virtuelle Sandbox-Umgebung, um den Operator zu trainieren, bevor Sie ihn in der realen Welt in die Produktion entlassen.

AI x Robotik und Automatisierung von Spielen/Desktops/Robotern wird der nächste große Schritt in der KI-Entwicklung sein, und es ist mein Ziel, mich frühzeitig zu positionieren.

Coded coded

6,37K

Louround 🥂 erneut gepostet

OpenAI hat heute meine nordsternartige These für KI mit der Veröffentlichung ihres Operator-Agenten bestätigt.

Nicht nur war dies meine leitende These für $CODEC, sondern auch für jede andere KI-Investition, die ich getätigt habe, einschließlich derjenigen aus dem frühen Jahr während des KI-Wahns.

Es gab viele Diskussionen mit Codec in Bezug auf Robotik. Während dieses Segment bald seine eigene Erzählung haben wird, ist der zugrunde liegende Grund, warum ich von Anfang an so optimistisch gegenüber Codec war, die Art und Weise, wie seine Architektur Operator-Agenten antreibt.

Die Leute unterschätzen immer noch, wie viel Marktanteil auf dem Spiel steht, wenn man Software entwickelt, die autonom läuft und menschliche Arbeiter ohne ständige Aufforderungen oder Aufsicht übertrifft.

Ich habe viele Vergleiche zu $NUIT gesehen. Zunächst möchte ich sagen, dass ich ein großer Fan von dem bin, was Nuit aufbaut, und wünsche ihnen nur Erfolg. Wenn du "nuit" in meinen Telegramm-Chat eingibst, wirst du sehen, dass ich im April gesagt habe, dass ich, wenn ich eine Münze für mehrere Monate halten müsste, Nuit aufgrund meiner Operator-These gewählt hätte.

Nuit war das vielversprechendste Operator-Projekt auf dem Papier, aber nach umfangreicher Recherche stellte ich fest, dass ihre Architektur die Tiefe fehlte, um eine große Investition zu rechtfertigen oder meinen Ruf dahinterzustellen.

In Anbetracht dessen war ich mir bereits der architektonischen Lücken in bestehenden Operator-Agenten-Teams bewusst und suchte aktiv nach einem Projekt, das diese ansprach. Kurz nachdem Codec auftauchte (danke an @0xdetweiler, der darauf bestand, dass ich tiefer in sie eintauche), ist dies der Unterschied zwischen den beiden:

$CODEC vs $NUIT

Die Architektur von Codec ist über drei Schichten aufgebaut: Maschine, System und Intelligenz, die Infrastruktur, Umgebungsinterface und KI-Logik trennen. Jeder Operator-Agent in Codec läuft in seiner eigenen isolierten VM oder Container, was nahezu native Leistung und Fehlertoleranz ermöglicht. Dieses geschichtete Design bedeutet, dass Komponenten unabhängig skalieren oder sich weiterentwickeln können, ohne das System zu brechen.

Die Architektur von Nuit verfolgt einen anderen Ansatz, indem sie monolithischer ist. Ihr Stack dreht sich um einen spezialisierten Webbrowser-Agenten, der Parsing, KI-Argumentation und Aktionen kombiniert. Das bedeutet, dass sie Webseiten tief in strukturierte Daten für die KI umwandeln und auf Cloud-Verarbeitung für schwere KI-Aufgaben angewiesen sind.

Der Ansatz von Codec, ein leichtgewichtiges Vision-Language-Action (VLA)-Modell in jeden Agenten einzubetten, bedeutet, dass es vollständig lokal laufen kann. Dies erfordert kein ständiges Pingen zur Cloud für Anweisungen, wodurch Latenz verringert und Abhängigkeiten von Verfügbarkeit und Bandbreite vermieden werden.

Der Agent von Nuit verarbeitet Aufgaben, indem er zunächst Webseiten in ein semantisches Format umwandelt und dann ein LLM-Gehirn verwendet, um herauszufinden, was zu tun ist, was sich im Laufe der Zeit mit verstärkendem Lernen verbessert. Während dies für die Webautomatisierung effektiv ist, hängt dieser Ablauf von schwerer KI-Verarbeitung in der Cloud und vordefinierten Seitenstrukturen ab. Die lokale Geräteintelligenz von Codec bedeutet, dass Entscheidungen näher an den Daten getroffen werden, was den Overhead reduziert und das System stabiler gegenüber unerwarteten Änderungen macht (keine fragilen Skripte oder DOM-Annahmen).

Die Operatoren von Codec folgen einem kontinuierlichen Wahrnehmen-Denken-Handeln-Zyklus. Die Maschinenschicht streamt die Umgebung (z. B. einen Live-App- oder Roboter-Feed) zur Intelligenzschicht über die optimierten Kanäle der Systemsicht, wodurch die KI "Augen" auf den aktuellen Zustand hat. Das VLA-Modell des Agenten interpretiert dann die visuellen und instruktiven Informationen zusammen, um eine Aktion zu entscheiden, die die Systemsicht durch Tastatur-/Mausereignisse oder Robotersteuerung ausführt. Dieser integrierte Zyklus bedeutet, dass er sich an Live-Ereignisse anpasst; selbst wenn sich die Benutzeroberfläche ändert, wird der Fluss nicht unterbrochen.

Um all dies in einer einfacheren Analogie zu erklären, denke an die Operatoren von Codec wie an einen selbständigen Mitarbeiter, der sich an Überraschungen im Job anpasst. Der Agent von Nuit ist wie ein Mitarbeiter, der anhalten muss, die Situation einem Vorgesetzten am Telefon beschreiben muss und auf Anweisungen warten muss.

Ohne zu sehr in technische Details abzutauchen, sollte dies dir eine grobe Vorstellung davon geben, warum ich Codec als meine Hauptwette auf Operatoren gewählt habe.

Ja, Nuit hat Unterstützung von YC, ein starkes Team und ein S-Rang-GitHub. Obwohl die Architektur von Codec mit horizontaler Skalierung im Hinterkopf entwickelt wurde, was bedeutet, dass du Tausende von Agenten parallel ohne gemeinsamen Speicher oder Ausführungskontext zwischen den Agenten bereitstellen kannst. Das Team von Codec sind auch keine durchschnittlichen Entwickler.

Ihre VLA-Architektur eröffnet eine Vielzahl von Anwendungsfällen, die mit früheren Agentenmodellen nicht möglich waren, da sie durch Pixel und nicht durch Screenshots sehen.

15,87K

Hut ab vor dem Testnetz von @anoma!

Es bietet ein super flüssiges und unterhaltsames Erlebnis mit Nebenquests und täglichen Aufgaben.

Eine neue UI- und UX-Welt entsteht, und sie ist absichtsbasiert ⏳

Anoma15. Juli, 22:08

Eine Welt reiner Absicht erwartet dich...

Das Anoma-Testnetz ist live.

2,78K

Es ist unglaublich, dass wir im Jahr 2025 immer noch eine so große Fragmentierung sehen und Projekte zwischen Chains und Layers hin und her springen, nur um dem Hype nachzujagen.

🫳 Arbitrum zu Berachain zu Base zu HyperEVM zu [INSERT_NEXT_HYPED_CHAIN]

Baut einfach auf der absichtszentrierten Welt auf

Baut auf @anoma

Anoma10. Juli, 23:57

Oh nein, du hast deine App auf der 23. Ethereum Layer 2 gebaut und alle Benutzer sind bereits auf die 24. gewechselt???

4,75K

Louround 🥂 erneut gepostet

$CODEC ist codiert.

Aber WTF ist das und warum bin ich so bullish?

Lass mich dir eine kurze Zusammenfassung geben.

- @codecopenflow baut die erste umfassende Plattform für Vision-Language-Action (VLA) Modelle, die es KI-"Betreibern" ermöglicht, autonom über digitale Schnittstellen und robotische Systeme hinweg zu sehen, zu denken und zu handeln, durch eine einheitliche Infrastruktur.

- VLAs lösen/überwinden grundlegende Automatisierungsbeschränkungen von LLMs, indem sie eine Wahrnehmen-Denken-Handeln-Pipeline nutzen, die es ihnen ermöglicht, dynamische visuelle Semantiken zu verarbeiten, im Gegensatz zu den aktuellen LLMs, die in Screenshot-Denken-Ausführen-Schleifen stecken bleiben, wenn sich die Schnittstellen ändern.

- Die technische Architektur der VLAs vereint Vision, Sprachverständnis und direkte Aktionsbefehle in einem einzigen Modell, anstatt separate LLM- + visuelle Encoder-Systeme zu verwenden, was eine Echtzeitanpassung und Fehlerbehebung ermöglicht.

- Die framework-unabhängige Gestaltung von Codec erstreckt sich über Robotik (Kamerafeeds zu Steuerbefehlen), Desktop-Betreiber (kontinuierliche Schnittstellennavigation) und Gaming (adaptive KI-Spieler) durch denselben Wahrnehmen-Denken-Handeln-Zyklus.

- Was ist der Unterschied? LLM-gesteuerte Agenten planen neu, wenn sich Arbeitsabläufe ändern, und bewältigen UI-Verschiebungen, die starre RPA-Skripte brechen. VLA-Agenten hingegen passen sich mit visuellen Hinweisen und Sprachverständnis an, anstatt manuelle Patches zu benötigen.

- Die hardware-unabhängige Infrastruktur von Codec mit No-Code-Training über Bildschirmaufzeichnung plus Entwickler-SDK positioniert es als das fehlende Langchain-ähnliche Framework für autonome VLA-Aufgabenausführung.

- Das Framework ermöglicht die Aggregation von mart-Computing aus dezentralen GPU-Netzwerken, ermöglicht optionale Onchain-Aufzeichnungen für überprüfbare Arbeitsablaufverläufe und erlaubt die Bereitstellung privater Infrastrukturen für datenschutzempfindliche Anwendungsfälle.

- Die Tokenomics von $CODEC monetarisieren den Betreiber-Marktplatz und den Beitrag zur Berechnung, wodurch nachhaltige Anreizsysteme geschaffen werden, während VLAs die erwartete LLM-Ebene in verschiedenen Sektoren erreichen.

- Die Tatsache, dass ein Mitbegründer von Codec Erfahrung im Aufbau von HuggingFace's LeRobot hat, belegt die legitime Forschungs- und Entwicklungsfähigkeit in der Robotik und ML für die VLA-Entwicklung. Dies ist nicht dein durchschnittliches Krypto-Team, das sich auf KI-Narrative umschwenkt.

Ich werde bald tiefer in dieses Thema eintauchen.

Ich wiederhole meine Empfehlung, DYOR in der Zwischenzeit zu machen.

$CODEC ist codiert.

10,76K

Louround 🥂 erneut gepostet

Warum $CODEC die Zukunft autonomer Agenten anführt @codecopenflow

Die nächste Grenze der KI sind nicht mehr Textaufforderungen. Es geht um Handlung.

Die meisten KI-Agenten von heute stecken in einer Schleife fest, in der sie Screenshots lesen und Text ausgeben. Sie sehen keine Umgebungen, sie verstehen keine Veränderungen und sie können nicht mit Absicht in der realen Welt handeln. Hier hebt sich die VLA-Architektur (Vision-Language-Action) von Codec ab.

Stellen Sie sich Agenten vor, die nicht nur sprechen, sondern beobachten, schlussfolgern und handeln. Das ist das Herzstück von Codec.

Das sind keine brüchigen Skripte oder starren Bots. VLA-Operatoren interagieren mit Software, Spielen oder sogar physischen Robotern, indem sie kontinuierlich die Umgebung wahrnehmen, entscheiden, was zu tun ist, und Befehle ausführen: genau wie ein Mensch.

✅ Desktop-Agenten, die sich an sich ändernde UIs anpassen

✅ Gaming-Agenten, die Mechaniken lernen und in Echtzeit strategisieren

✅ Roboter-Agenten, die auf Sensordaten reagieren und Hardware steuern

✅ Training & Simulation in großem Maßstab, kein Roboter erforderlich

Die modulare Architektur von Codec ermöglicht es Ihnen, Vision-Modelle mit Sprachmodellen (wie CogVLM + Mixtral) zu kombinieren, um intelligente Agenten zu erstellen, die lesen, beobachten, verstehen und handeln können, alles in einer einzigen Pipeline.

Jeder Agent läuft auf seiner eigenen Recheneinheit (VM, Server oder Container), und jede Entscheidung, die er trifft, kann onchain protokolliert werden. Das bedeutet nachvollziehbare Aktionen, Sicherheitsgarantien und das Potenzial für kryptobasierte Anreizsysteme und Verantwortlichkeitsebenen in risikobehafteten Umgebungen.

Wir bewegen uns auf eine Welt zu, in der Operatoren trainiert, gehandelt und monetarisiert werden können. Ob für QA-Tests, Automatisierung robotischer Aufgaben oder sogar dezentrale Bot-Armeen in Spielen.

So wie Apps das Smartphone transformiert haben, werden Skill-Packs Roboter transformieren. Open-Source-Hardware + herunterladbare Intelligenz = das robotische Äquivalent zur Softwareentwicklung.

Das ist keine Science-Fiction. Es passiert jetzt.

Zuletzt und vielleicht am wichtigsten, die Grafik ist verdammt bullish.

10,01K

Top

Ranking

Favoriten

Onchain-Trends

Im Trend auf X

Aktuelle Top-Finanzierungen

Am bemerkenswertesten