Актуальні теми

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

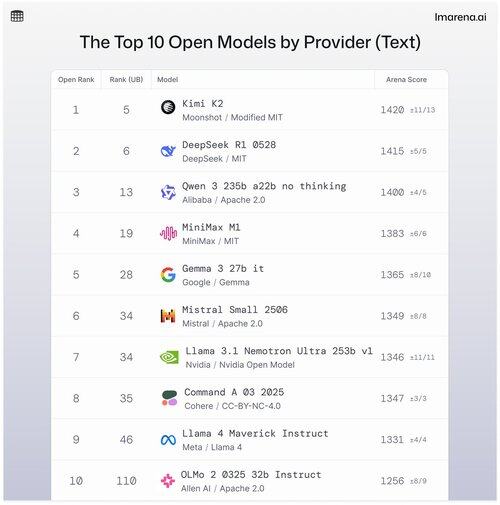

🧵Топ-10 відкритих моделей за провайдерами

Хоча фірмові моделі часто очолюють чарти, відкриті моделі також працюють у парі в режимі бою та входять до наших публічних таблиць лідерів.

Ось 10 найкращих, якщо складати їх за найкращими відкритими моделями за постачальниками.

- #1 Kimi K2 (модифікований MIT) @Kimi_Moonshot

- #2 DeepSeek R1 0528 (MIT) @deepseek_ai

- #3 Qwen 235b a22b без роздумів (Apache 2.0) @alibaba_qwen

- #4 MiniMax M1 (MIT) @minimax_ai

- #5 Gemma 3 27b it (Джемма) @googledeepmind

- #6 Mistral Small Ultra (Apache 2.0) @mistral_ai

- #7 Llama 3.1 Nemotron Ultra 253b v1 (відкрита модель Nvidia) @nvidia

- #8 Команда А (Когер) @cohere

- #9 Llama 4 Maverick Instruct (Лама 4) @aiatmeta

- #10 OLMo 2 32b Instruct (Apache 2.0) @allen_ai

Дивіться гілку, щоб дізнатися трохи більше про топ-5 у цьому списку 👇

Kimi K2 - #1 на відкритій арені!

Якщо ви звертали увагу на моделі з відкритим вихідним кодом, ця нова модель від зростаючої компанії зі штучного інтелекту, Moonshot AI, викликає хвилю як одна з найбільш вражаючих LLM з відкритим вихідним кодом на сьогоднішній день. Наша спільнота каже нам, що їм також подобається те, як реагує Kimi K2: Kimi жартівливий, але не звучить занадто роботизовано.

Kimi K2 побудований на архітектурі суміші експертів (MoE) із загальною кількістю 1 трильйона параметрів, з яких 32 мільярди є активними під час будь-якого заданого висновку. Така конструкція допомагає моделі збалансувати ефективність і продуктивність на вимогу.

Найкраща відкрита модель DeepSeek, DeepSeek R1-0528, займає #2 місце

R1-0528 — це вдосконалена версія R1, налаштована на інструкцію, і #2 найкраща модель відкритого чату на думку спільноти. Сильний у багатоходовому діалозі та завданнях на міркування.

R1 (базовий рівень) є оригінальним, все ще солідним, але тепер трохи відстає від нових варіантів тюнінгу.

V3-0324 – це модель MoE із загальними параметрами 236B, але активує лише кілька експертів на підказку. Це робить його одночасно потужним і ефективним. Він добре справляється з інструкціями, міркуваннями та багатомовними завданнями, але формат швидкого реагування тут має більше значення, ніж з R1-0528.

Qwen 235b a22b (без роздумів) є найкращою відкритою моделлю Alibaba на #3

235B-a22b-no-thinking - це сира модель без налаштування інструкцій (таким чином "без мислення").

Він чудово справляється з поколінням і займає високе місце в спільноті завдяки своїй грубій здатності міркувати.

Деякі інші топові відкриті моделі з нашою спільнотою від Alibaba включають:

Варіанти 32B і 30B-a3b є меншими та швидшими альтернативами з солідною продуктивністю, хоча вони відстають від моделей вищого рівня. Оскільки 32B є більш щільним серед двох, спільнота віддає перевагу його точності, а не 30B-a3b. 30B-a3b – це модель MoE, що робить її трохи швидшою.

QWQ-32b спеціально розроблений для вирішення складних проблем міркувань і має на меті відповідати продуктивності більших моделей, таких як DeepSeek R1, але не зовсім досягає цього сліду при тестуванні в реальних умовах.

MiniMax M1 потрапив до списку зі своїм рейтингом найкращих моделей на #4

M1 також вирізняється своїм унікальним підходом з архітектурою MoE у поєднанні з формою уваги під назвою «Lightning Attention», лінеаризованим механізмом, спеціально створеним для високоефективної обробки токенів.

Цей підхід, безумовно, привернув увагу нашої спільноти за те, що він дійсно хороший у діалозі, міркуванні та дотриманні інструкцій.

Google DeepMind опинився на #5 зі своєю найкращою відкритою моделлю Gemma 3 27b it

Gemma 3 – це мультимодальна модель мови з відкритою вагою. Gemma 3 може обробляти як текстові, так і графічні дані, досягаючи успіху в міркуваннях, завданнях з довгим контекстом і додатках на мові бачення. Нашій спільноті подобається, як ця Gemma покращила ефективність пам'яті та збільшила підтримку більшого контексту порівняно з попередніми версіями.

34,63K

Найкращі

Рейтинг

Вибране