Subiecte populare

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

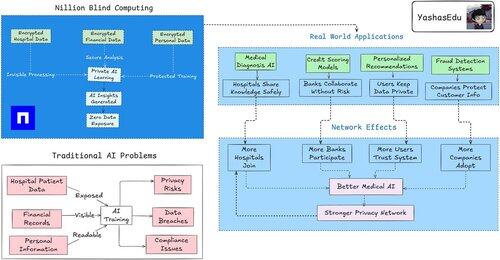

Confidențialitatea datelor în AI devine o problemă critică. Sistemele actuale necesită expunerea datelor pentru ca AI să învețe din ele, creând riscuri pentru informațiile sensibile.

@nillionnetwork lansat foaia de parcurs pentru 2025 pentru a construi o infrastructură de "calcul orb" în care AI poate procesa datele fără să le vadă efectiv.

+ Faza 0 (Q2): S-au concentrat pe stocarea distribuită cu criptare care permitea interogări LLM private

+ Faza 1 (Q3): Modelele AI pot efectua calcule pe date private, menținând în același timp auditabilitatea (@Tickrdotapp deja lansate, mai multe produse infrainfra sunt în curs de desfășurare)

+ Faza 2 (Q4): Instrumente și interfețe de dezvoltare pentru a accelera adoptarea

Știm cu toții că folosind @nillionnetwork, sistemele AI pot învăța modele și pot oferi informații fără a accesa informații brute.

> Tehnologia de coprocesare ZK extinde capacitățile pentru operațiunile AI/ML

> Creează infrastructură pentru învățarea automată privată la scară largă

> Combină procesarea AI + principiile de descentralizare

Acest lucru răspunde preocupărilor tot mai mari cu privire la expunerea datelor în antrenamentul AI.

Pe măsură ce modelele devin mai puternice, protejarea informațiilor sensibile, menținând în același timp funcționalitatea AI, devine esențială. @nillionnetwork va deveni mai important.

7 iul., 20:01

Vă prezentăm foaia de parcurs tehnologică a lui Nillion 2025.

Avansăm Blind Computer către o calcul mai profundă și o experiență perfectă pentru dezvoltatori.

Să ne scufundăm 🧵

1,6K

Limită superioară

Clasament

Favorite