Argomenti di tendenza

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

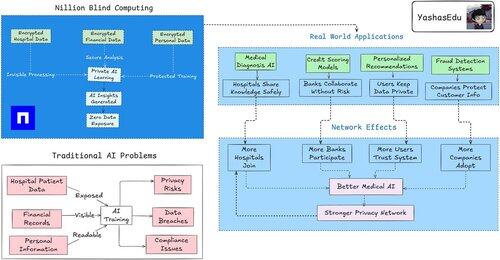

La privacy dei dati nell'IA sta diventando un problema critico. I sistemi attuali richiedono l'esposizione dei dati affinché l'IA possa apprendere da essi, creando rischi per le informazioni sensibili.

@nillionnetwork ha rilasciato la sua roadmap per il 2025 per costruire un'infrastruttura di "calcolo cieco" in cui l'IA può elaborare dati senza vederli effettivamente.

+ Fase 0 (Q2): Si sono concentrati su storage distribuito con crittografia che ha permesso query LLM private

+ Fase 1 (Q3): I modelli di IA possono eseguire calcoli su dati privati mantenendo l'auditabilità (@Tickrdotapp già disponibile, altri prodotti infrastrutturali sono in arrivo)

+ Fase 2 (Q4): Strumenti di sviluppo e interfacce per accelerare l'adozione

Sappiamo tutti che utilizzando @nillionnetwork, i sistemi di IA possono apprendere schemi e fornire approfondimenti senza accedere alle informazioni grezze.

> La tecnologia di coprocessamento ZK espande le capacità per le operazioni di IA/ML

> Crea un'infrastruttura per l'apprendimento automatico privato su larga scala

> Combina l'elaborazione dell'IA con i principi di decentralizzazione

Questo affronta le crescenti preoccupazioni riguardo all'esposizione dei dati nell'addestramento dell'IA.

Man mano che i modelli diventano più potenti, proteggere le informazioni sensibili mantenendo la funzionalità dell'IA diventa essenziale. @nillionnetwork diventerà sempre più importante.

7 lug, 20:01

Presentazione della Roadmap Tecnologica di Nillion 2025.

Stiamo portando il Computer Cieco verso un calcolo più profondo e un'esperienza di sviluppo senza soluzione di continuità.

Immergiamoci 🧵

1,58K

Principali

Ranking

Preferiti