Rubriques tendance

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

Andrej Karpathy

Bâtiment @EurekaLabsAI. Précédemment directeur de l’IA @ Tesla, équipe fondatrice @ OpenAI, CS231n/PhD @ Stanford. J’aime entraîner de grands réseaux 🧠🤖💥 neuronaux profonds

Modèles vidéo de diffusion mais maintenant - **en temps réel** !

Les filtres vidéo simples sont en temps réel mais ne peuvent faire que des recolorations et des styles de base. Les modèles de diffusion vidéo (Veo et ses amis) sont magiques, mais ils prennent de nombreuses secondes/minutes à générer. MirageLSD est de la magie en temps réel. Contrairement aux filtres vidéo simples, les modèles de diffusion comprennent réellement ce qu'ils regardent, donc ils peuvent styliser toutes les parties du flux de manière intelligente (par exemple, mettre des chapeaux sur des têtes, ou des sabres laser dans des mains, etc.). Et ils sont arbitrairement orientables, par exemple, par des invites textuelles.

Des filtres vidéo personnalisables et intelligents débloquent de nombreuses idées intéressantes au fil du temps :

- transformer les flux de caméra en réalités alternatives

- diriger et tourner vos propres films, en jouant des scènes avec des accessoires. En temps réel => retour/revue instantanés.

- coder des jeux d'ambiance autour de simples sphères/blocs, puis utiliser un modèle de diffusion en temps réel pour texturer votre jeu afin de le rendre magnifique.

- styliser et personnaliser n'importe quel flux vidéo : jeux, vidéos, ... par exemple Skyrim mais "PLUS ÉPIQUE" ? DOOM II mais avec la qualité moderne d'Unreal Engine juste avec une invite ? Film d'horreur mais "mignon, rose et uniquement des lapins" ? Je ne sais pas !

- arrière-plans pour appels Zoom+++

- essayer des vêtements virtuellement en temps réel

- lunettes : par exemple, cartooniser votre vision en temps réel ?

- nous pouvons maintenant construire le Miroir de la Vérité de Harry Potter, montrant le "flux brut" de vous dans le miroir mais augmenté avec vos désirs les plus profonds (tels qu'inférés par l'IA).

- Je ne sais pas, je manque probablement le plus gros, tant de choses !

(Divulgation : je suis (très petit) investisseur providentiel dans Decart, j'étais excité parce qu'à mon avis cette technologie va devenir très bonne très vite et elle semble générale, puissante mais c'est aussi techniquement très difficile. Félicitations à l'équipe pour le lancement !)

Decart18 juil., 04:44

Présentation de MirageLSD : Le premier modèle d'IA de diffusion en direct (LSD)

Entrez n'importe quel flux vidéo, d'une caméra ou d'une vidéo en direct à un écran d'ordinateur ou à un jeu, et transformez-le en n'importe quel monde que vous désirez, en temps réel (<40 ms de latence).

Voici comment cela fonctionne (avec une démo que vous pouvez utiliser !) :

347,63K

Je râle souvent sur le fait que 99 % de l'attention va bientôt être celle des LLM au lieu de l'attention humaine. À quoi ressemble un article de recherche pour un LLM plutôt que pour un humain ? Ce n'est certainement pas un pdf. Il y a un énorme potentiel pour une "application de recherche" extrêmement précieuse qui découvre cela.

Michael Levin10 juil., 22:47

Je suis constamment irrité de ne pas avoir le temps de lire le torrent de papiers intéressants qui arrivent de plus en plus vite de la part de personnes incroyables dans des domaines pertinents. D'autres scientifiques ont le même problème et n'ont pas le temps de lire la plupart de mes longs articles conceptuels non plus. Alors, pour qui écrivons-nous ces articles ?

Je suppose qu'au moins jusqu'à ce qu'ils tombent dans le même problème à cause de leur propre travail, les IA seront les seules à avoir réellement la bande passante pour lire tout ça. Je ne parle pas spécifiquement des modèles de langage d'aujourd'hui - supposons que nous parlons de n'importe quelle IA inévitable qui apparaîtra, capable de lire la littérature et d'avoir un impact sur la recherche (que ce soit en parlant aux humains ou en exécutant des plateformes d'automatisation de laboratoire/scientifiques robots).

Alors, comment devrions-nous écrire, sachant qu'une grande partie de notre public sera des IA (plus des cyborgs, des hybrides, des humains augmentés, etc.) ? Peut-être qu'il est trop tôt pour savoir quoi faire, mais nous ferions mieux de commencer à y réfléchir car supposer que notre public sera toujours des humains d'aujourd'hui semble intenable. Prendre au sérieux l'idée qu'un jour le public impactant sera très différent, et que les choses que nous écrivons maintenant sont en quelque sorte un ensemble d'entraînement pour de véritables êtres futurs divers, comment notre écriture change-t-elle ? ou est-ce que ça change ?

Que dites-vous @danfaggella @mpshanahan @Plinz @blaiseaguera ?

498,06K

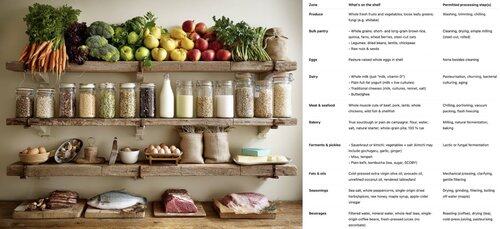

Comment construire une communauté open source florissante en écrivant du code comme le font les bactéries 🦠. Le code bactérien (génomes) est :

- petit (chaque ligne de code coûte de l'énergie)

- modulaire (organisé en groupes d'opérons interchangeables)

- autonome (facilement "copiable-collable" via le transfert horizontal de gènes)

Si des morceaux de code sont petits, modulaires, autonomes et trivials à copier-coller, la communauté peut prospérer grâce au transfert horizontal de gènes. Pour toute fonction (gène) ou classe (opéron) que vous écrivez : pouvez-vous imaginer quelqu'un dire "yoink" sans connaître le reste de votre code ou avoir à importer quoi que ce soit de nouveau, pour en tirer un bénéfice ? Votre code pourrait-il être un gist tendance sur GitHub ?

Ce guide de style de codage a permis aux bactéries de coloniser chaque recoin écologique, du froid au chaud, en passant par l'acide ou l'alcalin, dans les profondeurs de la Terre et le vide de l'espace, avec une diversité incroyable d'anabolisme du carbone, de métabolisme énergétique, etc. Il excelle dans le prototypage rapide mais... il ne peut pas construire une vie complexe. En comparaison, le génome eucaryote est un monorepo significativement plus grand, plus complexe, organisé et couplé. Beaucoup moins inventif mais nécessaire pour la vie complexe - pour construire des organes entiers et coordonner leur activité. Avec notre avantage de conception intelligente, il devrait être possible de tirer parti des deux. Construisez un backbone de monorepo eucaryote si vous devez, mais maximisez l'ADN bactérien.

538,72K

La course pour le "noyau cognitif" des LLM - un modèle de quelques milliards de paramètres qui sacrifie au maximum la connaissance encyclopédique pour la capacité. Il vit toujours activé et par défaut sur chaque ordinateur en tant que noyau de l'informatique personnelle LLM.

Ses caractéristiques se cristallisent lentement :

- Multimodal natif texte/vision/audio à la fois en entrée et en sortie.

- Architecture de style Matryoshka permettant de régler la capacité à la hausse ou à la baisse au moment du test.

- Raisonnement, également avec un réglage. (système 2)

- Utilisation agressive d'outils.

- Slots de finetuning LoRA sur l'appareil pour l'entraînement en temps de test, la personnalisation et la personnalisation.

- Délègue et vérifie juste les bonnes parties avec les oracles dans le cloud si Internet est disponible.

Il ne sait pas que le règne de Guillaume le Conquérant s'est terminé le 9 septembre 1087, mais il reconnaît vaguement le nom et peut rechercher la date. Il ne peut pas réciter le SHA-256 de la chaîne vide comme e3b0c442..., mais il peut le calculer rapidement si vous le souhaitez vraiment.

Ce qui manque à l'informatique personnelle LLM en termes de large connaissance du monde et de capacité de résolution de problèmes de haut niveau, il le compensera par une latence d'interaction super basse (surtout à mesure que le multimodal mûrit), un accès direct / privé aux données et à l'état, une continuité hors ligne, une souveraineté ("pas vos poids, pas votre cerveau"). c'est-à-dire beaucoup des mêmes raisons pour lesquelles nous aimons, utilisons et achetons des ordinateurs personnels au lieu d'avoir des clients légers accédant à un cloud via un bureau à distance ou autre.

1,03M

Meilleurs

Classement

Favoris

Tendance on-chain

Tendance sur X

Récents financements de premier plan

Les plus notables