Tendencias del momento

#

Bonk Eco continues to show strength amid $USELESS rally

#

Pump.fun to raise $1B token sale, traders speculating on airdrop

#

Boop.Fun leading the way with a new launchpad on Solana.

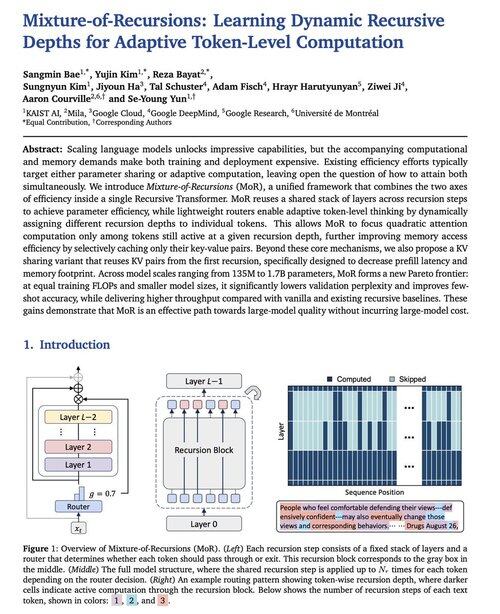

Google DeepMind acaba de lanzar esta nueva arquitectura de modelo LLM llamada Mixture-of-Recursions.

Obtiene el doble de velocidad de inferencia, reduce los FLOPs de entrenamiento y ~50% menos de memoria de caché KV. Una lectura realmente interesante.

Tiene el potencial de ser un asesino de Transformers.

Fuente:

237,3K

Parte superior

Clasificación

Favoritos